EU-kommissionens förslag till reglering av artificiell intelligens (AI) har läckt ut via olika media.

Bloomberg rapporterar följande:

- AI systems used to manipulate human behavior, exploit information about individuals or groups of individuals, used to carry out social scoring or for indiscriminate surveillance would all be banned in the EU. Some public security exceptions would apply.

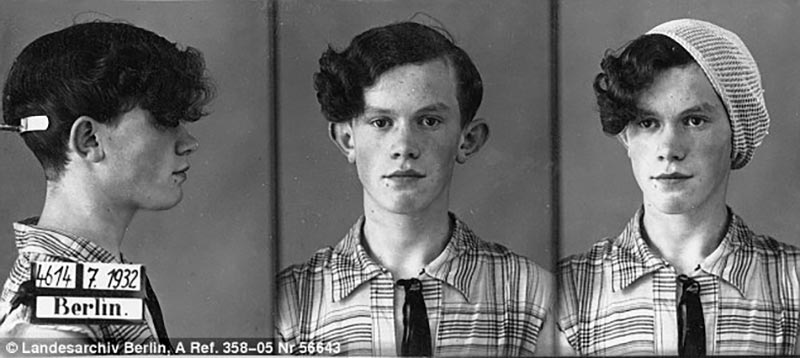

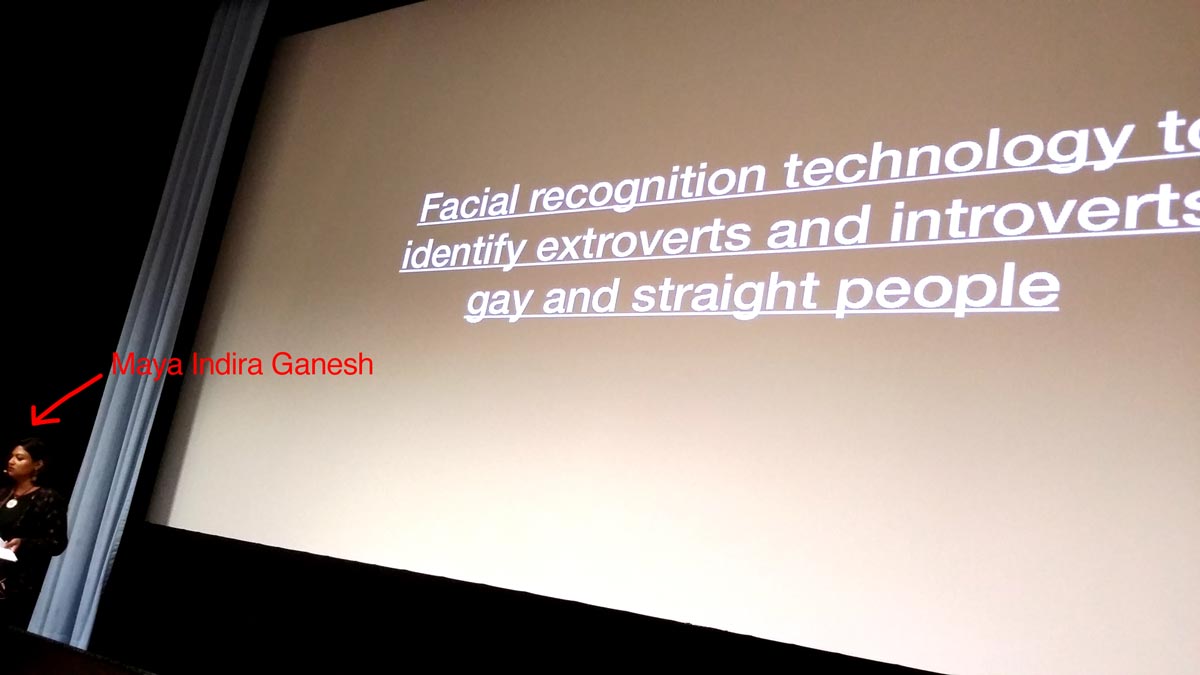

- Remote biometric identification systems used in public places, like facial recognition, would need special authorization from authorities.

- AI applications considered to be ‘high-risk’ would have to undergo inspections before deployment to ensure systems are trained on unbiased data sets, in a traceable way and with human oversight.

- High-risk AI would pertain to systems that could endanger people’s safety, lives or fundamental rights, as well as the EU’s democratic processes — such as self-driving cars and remote surgery, among others.

- Some companies will be allowed to undertake assessments themselves, whereas others will be subject to checks by third-parties. Compliance certificates issued by assessment bodies will be valid for up to five years.

- Rules would apply equally to companies based in the EU or abroad.

Särskilt intressant är att titta på undantagen. Till exempel kommer dessa regler inte att gälla för militär verksamhet. Vidare är »public security exceptions« en brasklapp som i praktiken kan öppna för vad som helst.

Medias rubriker talar om att EU skulle införa ett förbud mot AI-stödd ansiktsigenkänning. Vilket inte är vad som står i den läckta texten. Istället talas om »special authorization from authorities« – vilket är ytterligare en brasklapp som ger politiker och myndigheter stort svängrum.

Läckta texter är ofta arbetstexter som kan komma att ändras innan de läggs fram, så det ovanstående kan komma att ändras. I detta fall väntas ett skarpt förslag från EU-kommissionen den 21 april. Förslaget skall sedan knådas och godkännas av medlemsstaterna och av Europaparlamentet.