Nu reglerar EU användningen av artificiell intelligens – med stora undantag för brottsbekämpande myndigheter. Här är vad man har förhandlat fram.

Det finns nu i princip en överenskommelse mellan EU:s tre institutioner om dess nya reglering av artificiell intelligens, the AI Act. I princip, eftersom det fortfarande tycks råda en viss oklarhet om vad man beslutat i detalj.

Överenskommelsen är resultatet av trilog-förhandlingar – i vilka kommissionen, ministerrådet och parlamentet stänger in sig bakom stängda dörrar för att utarbeta en kompromiss utan offentlig insyn.

Trots att det inte finns något stöd för triloger i EU:s fördrag avgörs idag nio av tio lagförslag i EU genom dessa hemliga förhandlingar. Vilket är ett demokratiskt problem. Lagstiftning måste tåla insyn.

Än mer svajigt blir det om man betänker att detta är lagstiftning där den tekniska utvecklingen går med rasande fart. Plus att det är oklart om beslutsfattarna verkligen förstår vad AI är och hur den fungerar.

Men det är som det är. Till saken. Vad har man kommit fram till?

- EU vill ha insyn i och viss möjlighet att påverka AI-system som anses vara hög risk för individen, samhället och ekonomin. Här ställs även krav på transparens, konsekvensanalyser och energianvändning.

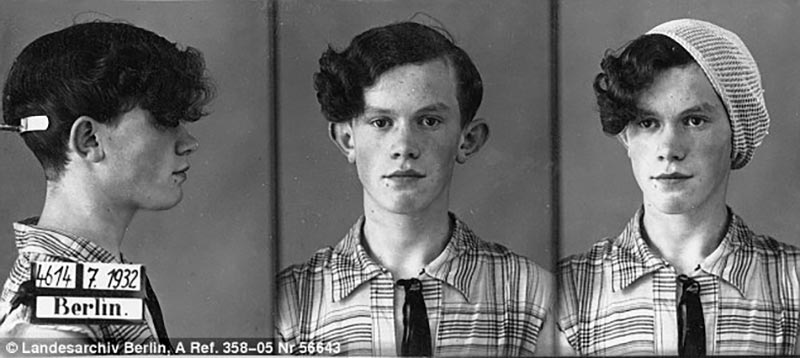

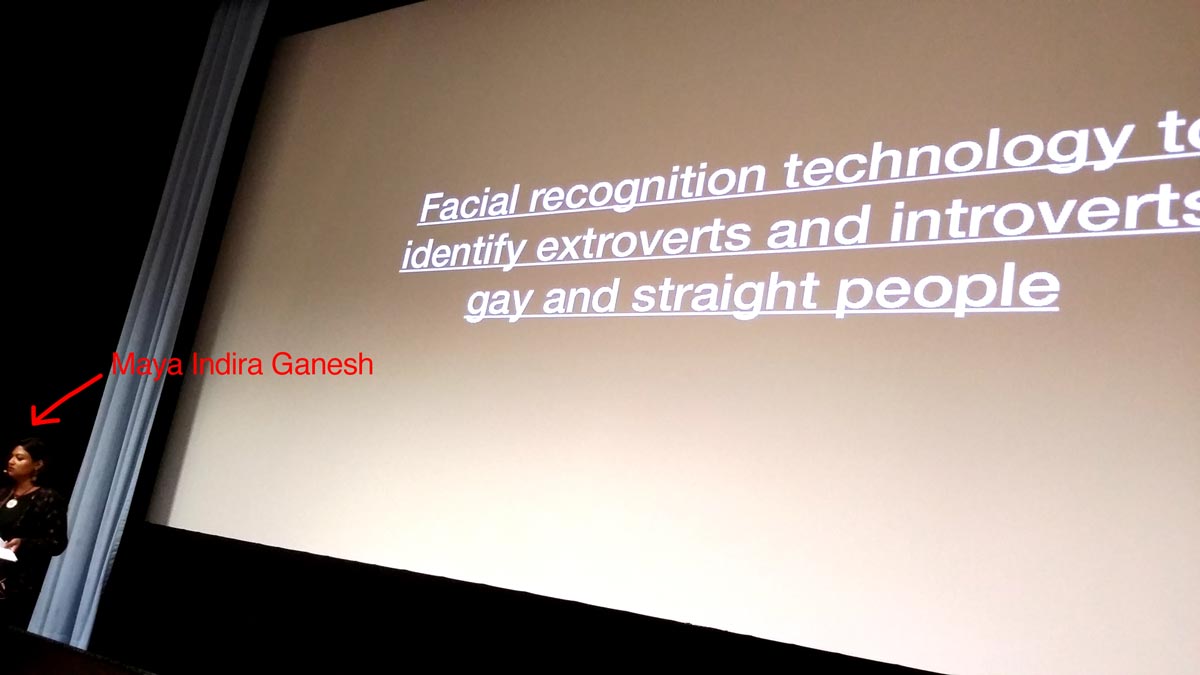

- Man förbjuder automatiserad ansiktsigenkänning i realtid, utom vad gäller att identifiera gärningsmän och offer vid vissa typer av brott och för att bekämpa terrorism.

- Automatiserad ansiktsigenkänning i efterhand begränsas till utredning av allvarliga brott.

- Användning av AI för förebyggande brotssbekämpning (pre-crime) begränsas delvis, speciellt om den bygger på personlighets- och karaktärsdrag (t.ex. ras, politisk åsikt eller religion – om inte sådana uppgifter har en direkt betydelse till ett visst brott eller hot).

- Användning av AI för att upptäcka och registrera känslor förbjuds på arbetsplatser och inom utbildningsväsendet utom när det sker i säkerhetssyfte.

- AI får inte användas för manipulation, exploatering av sårbarheter och sociala poängsystem (social scoring).

- Militär användning undantas från begränsningar, så länge den är i linje med EU:s fördrag.

- Fri och open source-mjukvara undantas från lagstiftningen utom när tillämpningen anses vara förenad med hög risk eller förbud enligt ovan.

- Ett AI Office skall upprättas hos EU-kommissionen, en European Artificial Intelligence Board skall etableras liksom ett rådgivande forum och en vetenskaplig panel.

EU:s AI Act är tänkt att träda ikraft inom två år, med undantag för vissa förbud som skall börja gälla redan efter sex månader från det att rådet och parlamentet bekräftat trilogens kompromiss.

Hur tekniken kommer att se ut om två år och om lagstiftningen över huvud taget är relevant då är en öppen fråga.

Och som vanligt finns alltid en påtaglig risk för ändamålsglidning, missbruk av dessa verktyg och för vad de kan komma att användas till av auktoritära eller totalitära politiska krafter.

EU:s AI Act sätter också strålkastarljuset på Chat Control som nu av allt att döma skjutits på framtiden, till nästa mandatperiod. Att låta AI granska innehållet i medborgarnas elektroniska meddelanden samtidigt som man ger myndigheterna relativt fria händer på området tar frågan till en ny nivå. Detta bör uppmärksammas i vårens EU-valrörelse.

Några länkar:

• Europaparlamentet: Artificial Intelligence Act: deal on comprehensive rules for trustworthy AI »

• EU-kommissionen: Commission welcomes political agreement on Artificial Intelligence Act »

• EDRi – EU AI Act: Deal reached, but too soon to celebrate »

• Euractiv: AI Act: EU policymakers nail down rules on AI models, butt heads on law enforcement »

• Euractiv: European Union squares the circle on the world’s first AI rulebook »